Pricing

Log In

Drop image or Upload image

Character

Library

Demo Preview

Kling Avatar 2.0

Kling Avatar 2.0

Kling Avatar 2.0 是一个先进的基于音频驱动的AI虚拟人系统,可以生成长达5分钟的视频,具有强大的身份一致性、自然的唇同步和连贯的长时间动作。其多模态导演和多角色控制功能使情感表达更丰富,场景叙事更精准,非常适合创作者、品牌和教育工作者。

探索 Kling Avatar 2.0 的功能

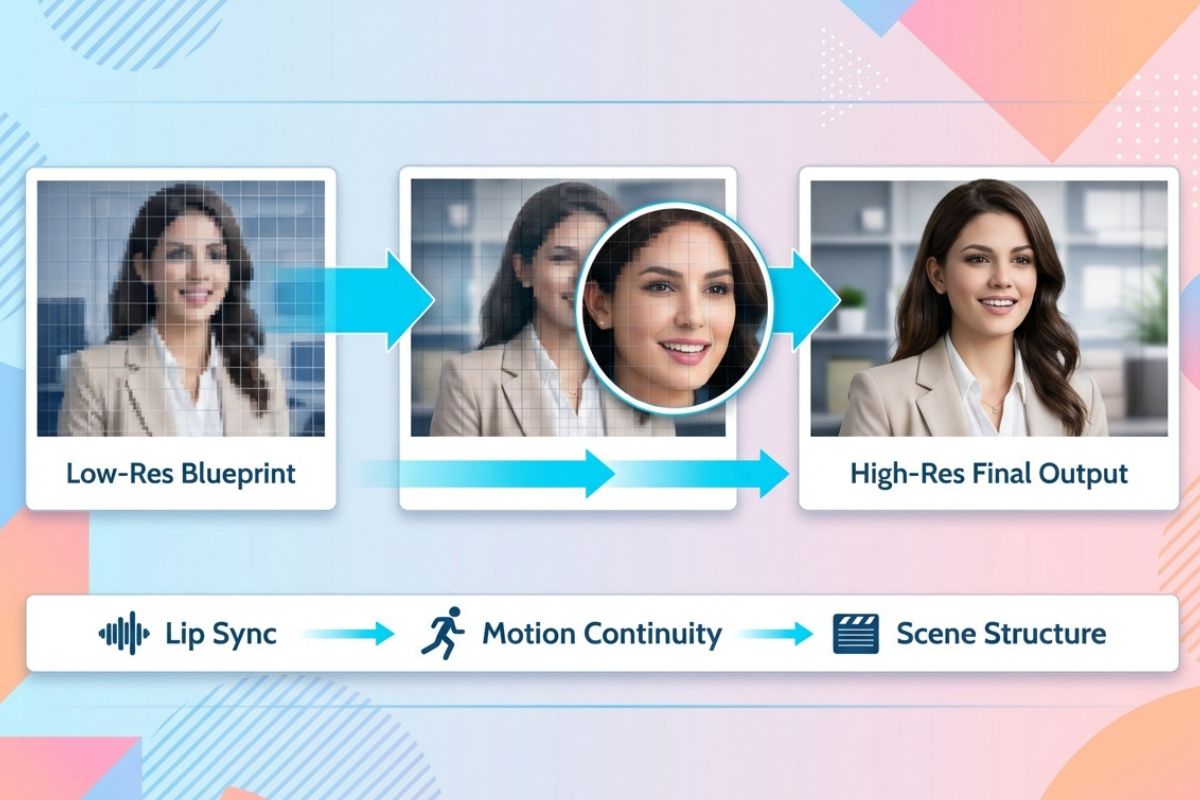

时空级联

Kling Avatar 2.0 使用低分辨率的"蓝图"加上逐步优化,生成多分钟、时间连贯的视频而不会出现身份漂移。

这种级联方法保留了唇同步、动作连续性和场景结构,使其在长篇解释、教程和品牌内容中表现可靠。

协同推理导演

Kling AI 的协同推理导演协调音频、视觉和文本专家,将模糊的指令转化为镜头级计划和情感细节。

基于Kling 2.6的进步,它迭代解决模态冲突,生成连贯且上下文感知的表演。

身份感知的多角色控制

角色特定的蒙版预测和多流音频驱动保持每个虚拟人的声音、目光和嘴部动作独立,避免交叉干扰伪影。

与拥有丰富模板库的AI虚拟人生成器配合使用,团队可以快速组装具有一致风格的高质量多角色场景。

高效的生产与部署

轨迹保留蒸馏和逐镜负向引导降低推理成本,同时保持视觉保真度,从而实现大规模生产工作流程。

结果是通过像OCMaker AI这样的平台,为博主和视频博主提供经济实惠的AI虚拟人解决方案。

Kling Avatar 2.0 的关键功能

支持长视频

支持长达5分钟的连续视频生成,大幅提升课程、访谈和长篇广告的叙事能力。

增强的文本理解与指令执行

相比竞争对手,能够更强地理解复杂文本指令,能够执行多镜头、多动作、情感和场景切换指令。

更自然的情感表达与面部细节

面部动作、目光、眉毛动态和嘴部表情与音频情感紧密对齐,实现更细腻复杂的情感表演。

改进的动作协调与物理真实性

头发、手势和身体动作与音频节奏更好地同步,减少抖动、失真和不自然的姿势,呈现更真实的效果。

高质量的多角色训练与泛化

使用大规模多角色数据集,结合自动化标注管道,增强多角色场景的稳定性和泛化能力。

更强的可控性与负向引导

通过负向提示和轨迹蒸馏减少伪影和错误动作,生成更干净、更稳定、更可控的输出。

如何使用 Kling Avatar 2.0?

简单步骤即可创建惊人内容

01

上传您的参考图片

首先上传一张参考照片,以确定 Kling Avatar 2.0 视频的视觉风格、角色外观或品牌形象。

02

输入您的提示

编写提示以定义场景、动作和情绪。包括情感、节奏、镜头风格或对话方向等细节,以指导虚拟人的表演。

03

调整设置并生成

设置输出选项,如分辨率、纵横比和长度,然后点击生成。查看结果,必要时进行微调,并导出最终的 Kling Avatar 2.0 视频。

常见问题解答